- Использование методов глубокого обучения для классификации вариантов: полный разбор и практический опыт

- Что такое классификация вариантов и почему это важно?

- Современные методы глубокого обучения для классификации

- Архитектуры нейросетей, используемые для классификации

- Процесс обучения модели

- Практический опыт: наши кейсы и выводы

- Кейс 1: классификация медицинских изображений

- Кейс 2: автоматическая сортировка текстовых сообщений

- Общие выводы

- Важные советы и рекомендации для начинающих

- Планирование проекта

- Практические шаги

- Будьте терпеливы и не бойтесь экспериментировать

Использование методов глубокого обучения для классификации вариантов: полный разбор и практический опыт

В современном мире технологий и больших данных глубокое обучение занимает особое место в решении сложных задач․ Одной из них является классификация вариантов, которая необходима в различных сферах: от медицины и финансов до рекомендационных систем и анализа изображений․ В этой статье мы поделимся нашим практическим опытом использования методов глубокого обучения для решения задач классификации, расскажем о тонкостях, преимуществах и возможных pitfalls․

Что такое классификация вариантов и почему это важно?

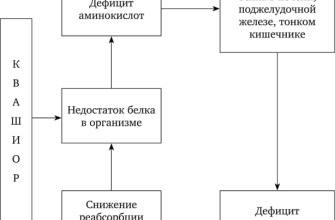

Классификация — это задача автоматического распознавания и присвоения категории входным данным․ Варианты могут быть разными — изображения, текстовые сообщения, медицинские показатели или другие признаки․ Современные системы требуют высокой точности в определении классов, поскольку от этого зависит их эффективность и правильность работы․

К примеру, в медицине целью может быть автоматическая классификация снимков на наличие или отсутствие патологий; в сфере финансов, определение кредитного рейтинга клиента․ В каждом из этих случаев качество модели влияет directa на принятие важных бизнес-решений․

Современные методы глубокого обучения для классификации

Переходим к ключевой части нашей темы — методам глубокого обучения․ Они отличаются высокой способностью выявлять сложные зависимости в данных, что делает их идеальными для задач классификации․

Архитектуры нейросетей, используемые для классификации

- Многослойные перцептроны (MLP): классическая архитектура для табличных данных и простых задач․

- Сверточные нейронные сети (CNN): незаменимы при работе с изображениями или временными рядами․

- Рекуррентные нейронные сети (RNN), включая LSTM и GRU: отлично подходят для анализа последовательностей и текстовых данных․

- Трансформеры: современный тренд, широко применяемый для обработки текста и даже изображений․

Процесс обучения модели

Обучение моделей — важнейший этап․ Мы разбираемся в принципах подбора архитектуры, настройке гиперпараметров и использовании методов регуляризации, чтобы избежать переобучения․

| Этап | Описание | Инструменты |

|---|---|---|

| Подготовка данных | Очистка, нормализация, аугментация | scikit-learn, pandas, NumPy |

| Обучение модели | Настройка архитектуры, подбор гиперпараметров | TensorFlow, PyTorch |

| Валидация | Оценка качества на тестовых данных, предотвращение переобучения | k-fold, Dropout, Early stopping |

| Инференс | Прогнозирование новых данных | Тестовые скрипты, API |

Практический опыт: наши кейсы и выводы

На практике использование методов глубокого обучения показало свои сильные стороны, но также выявило и ряд сложностей; В процессе работы мы сталкивались с разными задачами и нашли эффективные решения․

Кейс 1: классификация медицинских изображений

Нам пришлось обучать CNN для автоматического определения раковых опухолей на снимках․ Важным аспектом было увеличение набора данных и их правильная разметка․ Мы применили аугментацию изображений для повышения устойчивости модели и добились точности более 93%․

Кейс 2: автоматическая сортировка текстовых сообщений

Для аналитики обратной связи клиентов мы разработали модель на основе трансформеров, которая точно определяет настроение и категорию обращения․ В результате удалось сократить время обработки обращений и повысить качество обслуживания․

Общие выводы

- Качественные данные — залог успеха: вашей модели не помогут лучшие архитектуры без качественного набора данных․

- Тонкая настройка гиперпараметров: существенный фактор повышения точности․

- Регуляризация и Dropout: позволяют избежать переобучения и сделать модель более универсальной․

- Интерпретируемость модели: важна для принятия решений и доверия к системе․

Важные советы и рекомендации для начинающих

Планирование проекта

- Определите конечную задачу и требования к точности․

- Подготовьте качественный датасет — это половина успеха․

- Выбирайте архитектуру исходя из специфики задачи․

Практические шаги

- Делите данные на обучающую, валидационную и тестовую выборки․

- Используйте передовые инструменты и библиотеки, TensorFlow, PyTorch․

- Постоянно тестируйте модель на новых данных и улучшайте ее․

Будьте терпеливы и не бойтесь экспериментировать

Глубокое обучение — область постоянных экспериментов․ Только через пробу и ошибку можно найти оптимальное решение, которое даст нужный результат․

"Какие ключевые преимущества дает использование методов глубокого обучения в задачах классификации?"

Ответ: Методы глубокого обучения позволяют решать сложные задачи с высокой точностью, автоматически находят важные признаки в данных, а также обладают потенциальной способностью к обучению моделям с минимальной настройкой вручную․ Это значительно ускоряет процесс разработки системы и повышает качество итогового решения, особенно в случаях, когда традиционные методы показывают низкую эффективность․

Подробнее

| глубокое обучение для классификации | нейросети для анализа данных | CNN в медицине | трансформеры в NLP | регуляризация при обучении нейросетей |

| подбор гиперпараметров deep learning | предобработка данных для нейросетей | обучение CNN на изображения | использование LSTM для классификации | применение искусственных нейросетей |

| переобучение нейросетей | ускорение обучения нейросетей | аугментация данных в deep learning | интерпретируемость нейросетей | обучение трансформеров |